Productos destacados

2 meses ago

Soy médico de familia y una de las tareas más importantes en mi práctica cotidiana es la prevención. Casi todos los días, en el consultorio, intento ofrecerles a mis pacientes ciertas prácticas…

2 meses ago

¡Buen día! Leer este correo te va a llevar poco más de 5 minutos. 1. Diarrea del viajero ¿qué hacer? Tener diarrea durante un viaje es una situación muy habitual que no suele ser grave pero que puede…

2 meses ago

Referencias: DA: diarrea aguda; RHE: rehidratación por vía endovenosa; TRO: terapia de rehidratación oral; TAE: tratamiento antibiótico empírico; 1. Loperamida solo en adultos con DA no invasiva; 2…

2 meses ago

Soy médico de familia y una de las tareas más importantes en mi práctica cotidiana es la prevención. Casi todos los días, en el consultorio, intento ofrecerles a mis pacientes ciertas prácticas…

Curso Superior de Medicina Familiar y Ambulatoria PROFAM A – Julio 2025

eBook – Niñez y adolescencia: Manual de atención médica ambulatoria

Curso Superior de Medicina Familiar y Ambulatoria PROFAM B – Julio 2025

Curso Superior de Medicina Familiar y Ambulatoria PROFAM A – Julio 2025

Tu donación se destina íntegramente a mejorar la atención en el Centro de Salud y sostener programas como rondas, atención en domicilio, GES y diversidad.

+

Tu donación se destina íntegramente a mejorar la atención en el Centro de Salud y sostener programas como rondas, atención en domicilio, GES y diversidad.

+

Sentidos y prácticas en torno a la salud menstrual integral en profesionales de la salud

Revista EVIDENCIA publicó un nuevo artículo: ISentidos y prácticas en torno a la salud menstrual…

Riesgo cardiovascular en mujeres trans que utilizan terapia de hormonización con estrógenos

Revista EVIDENCIA publicó un nuevo artículo: IRiesgo cardiovascular en mujeres trans que utilizan terapia de…

Una mirada acerca del rastreo del cáncer de pulmón: ¿Estamos listos para implementar el tamizaje?

Revista EVIDENCIA publicó un nuevo artículo: IUna mirada acerca del rastreo del cáncer de pulmón:…

Sentidos y prácticas en torno a la salud menstrual integral en profesionales de la salud

Revista EVIDENCIA publicó un nuevo artículo: ISentidos y prácticas en torno a la salud menstrual…

Seguro de mala praxis

A partir de lo hablado en la actividad núcleo del 23/04/25, a continuación te dejamos…

Definí la obesidad, no dejes que la obesidad te defina a vos

Esta pieza es traducción de ‘This EBM Focus was written by Katharine DeGeorge, MD, MS,…

¿Aspirina para prevenir trombosis después de artroplastia? ¡Sí, y con evidencia de calidad!

Escrito por Karin Kopitowski Durante años, los anticoagulantes orales (OACs) han sido la opción estándar…

Seguro de mala praxis

A partir de lo hablado en la actividad núcleo del 23/04/25, a continuación te dejamos…

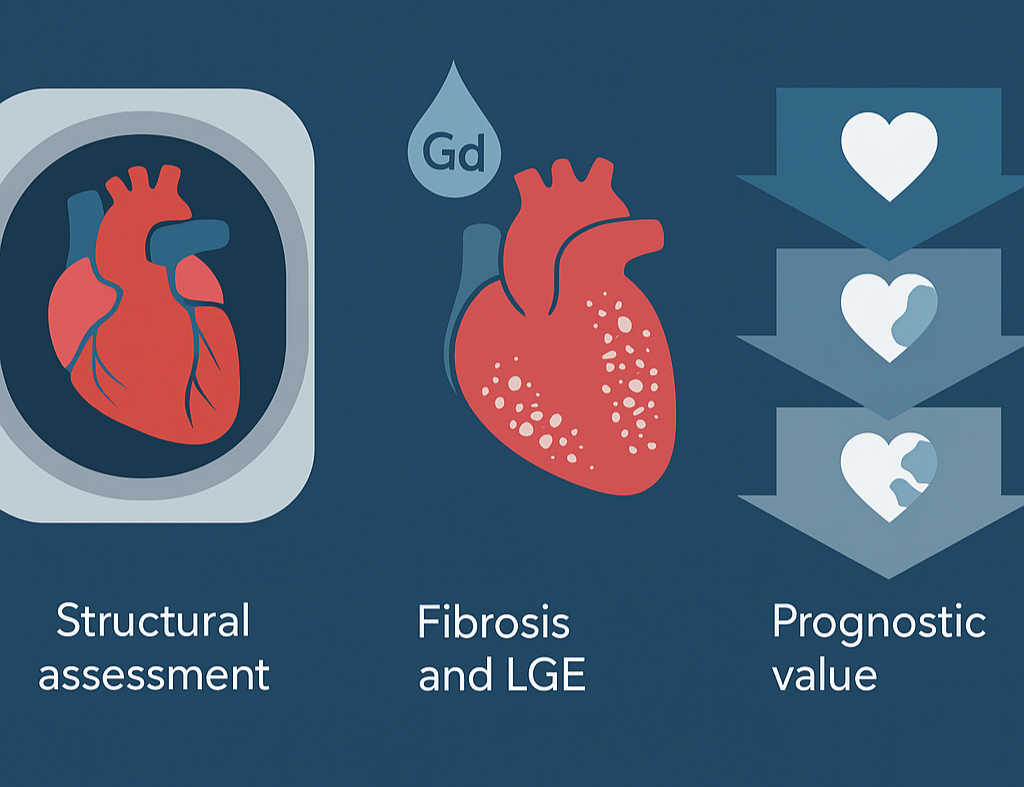

Cardioresonancia como marcador pronóstico del niño con miocardiopatía hipertrófica

La miocardiopatía hipertrófica es una miocardiopatía hereditaria, que se caracteriza por la hipertrofia del ventrículo…

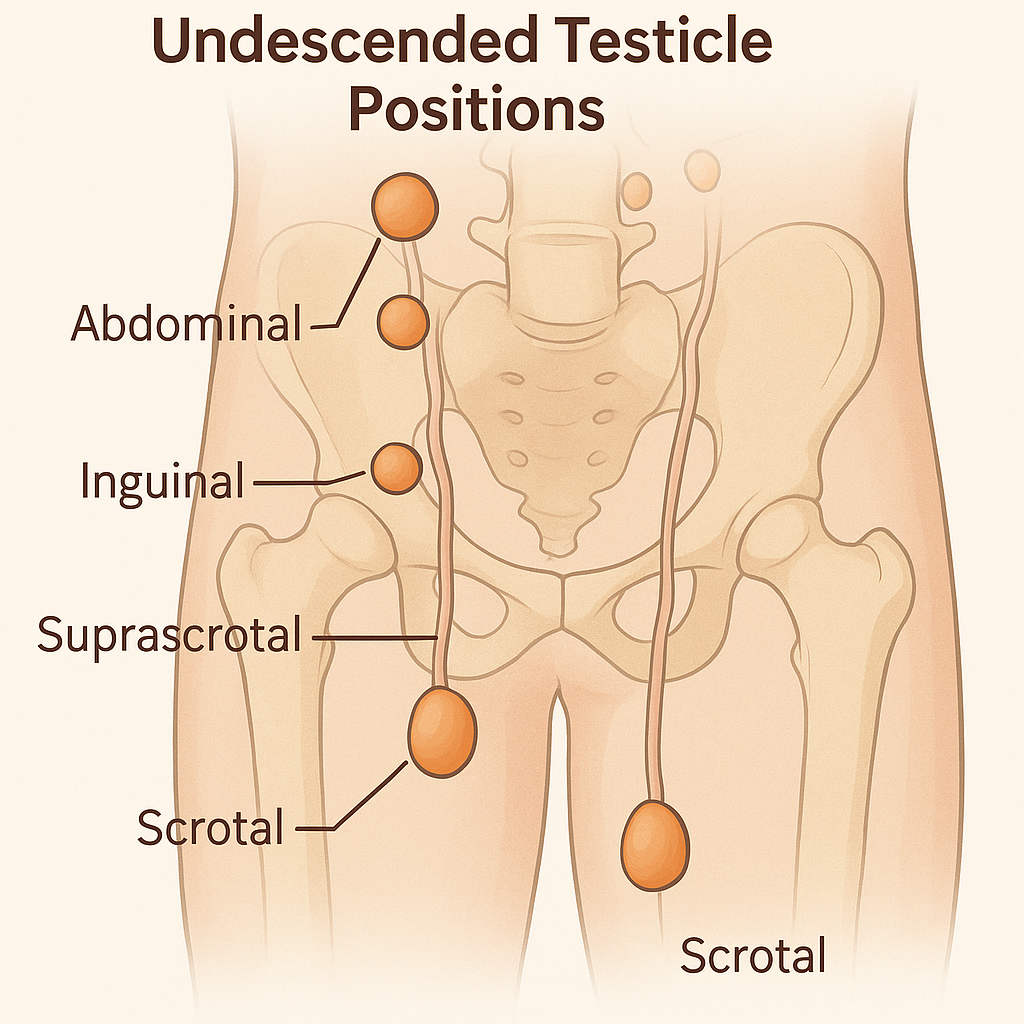

Manejo de la criptorquidia: actualización.

La criptorquidia es la ausencia del testículo en el fondo escrotal de uno o ambos…

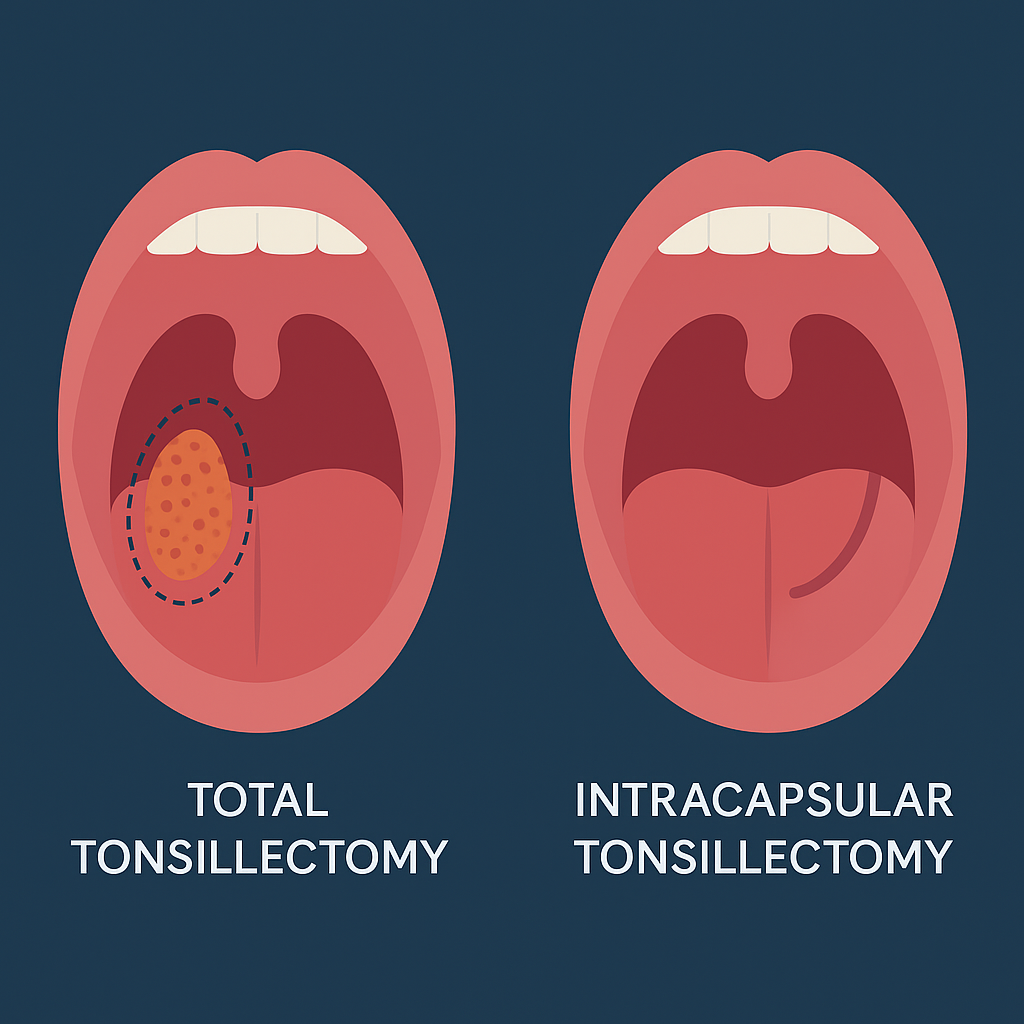

Amigdalectomía parcial en niños con trastornos respiratorios en el sueño

La apnea obstructiva del sueño (AOS) es una consulta frecuente de la población infantil, fundamentalmente…

Cardioresonancia como marcador pronóstico del niño con miocardiopatía hipertrófica

La miocardiopatía hipertrófica es una miocardiopatía hereditaria, que se caracteriza por la hipertrofia del ventrículo…

Cómo influye el miocribioma en la salud.

El microbioma está compuesto por bacterias, virus, hongos y arqueas (un dominio de organismos unicelulares…

Manejo de la criptorquidia: actualización.

La criptorquidia es la ausencia del testículo en el fondo escrotal de uno o ambos…

Cómo influye el miocribioma en la salud.

El microbioma está compuesto por bacterias, virus, hongos y arqueas (un dominio de organismos unicelulares…

Otras formas de producir endorfinas

Hemos escuchado muchas veces que la actividad física genera endorfinas en nuestro cuerpo, más precisamente…

Botiquín de viaje y algunas recomendaciones

Cuando planificamos un viaje, sobre todo cuando el destino es lejano, se nos presenta la…

Campaña de prevención contra el sarampión

El sarampión es una enfermedad viral bastante contagiosa que se transmite por el aire. Puede…

Otras formas de producir endorfinas

Hemos escuchado muchas veces que la actividad física genera endorfinas en nuestro cuerpo, más precisamente…

Directivas anticipadas*

*Este contenido esta disponible solamente para los integrantes del Servicio de Medicina Familiar y Comunitaria…

Guardias MF*

*Este contenido esta disponible solamente para los integrantes del Servicio de Medicina Familiar y Comunitaria…

Terapias Alternativas*

*Este contenido esta disponible solamente para los integrantes del Servicio de Medicina Familiar y Comunitaria…

Directivas anticipadas*

*Este contenido esta disponible solamente para los integrantes del Servicio de Medicina Familiar y Comunitaria…